W dzisiejszym świecie sztucznej inteligencji (AI) i uczenia maszynowego (ML), duże modele językowe stały się kluczowym elementem rewolucji technologicznej. Co to jest LLM? To skrót od Large Language Model, czyli duży model językowy – zaawansowany algorytm AI, który przetwarza, rozumie i generuje tekst podobny do ludzkiego na podstawie ogromnych zbiorów danych. Modele te, takie jak GPT-4 czy Llama, opierają się na architekturze transformera i pozwalają na zadania od prostych odpowiedzi na pytania po skomplikowane generowanie kodu czy treści kreatywnych.

Podstawy i definicje

Duże modele językowe (LLM) ewoluowały z prostych systemów przetwarzania języka naturalnego (NLP) do potężnych narzędzi AI. Zanim zanurzymy się w szczegóły, zrozumiemy, czym LLM różni się od klasycznych podejść i jakie kluczowe pojęcia stoją za ich sukcesem.

LLM vs. klasyczne NLP (czym się różnią, co zyskał Transformer)

Klasyczne NLP opierało się na regułach gramatycznych, statystykach i prostych sieciach neuronowych, jak RNN (Recurrent Neural Networks). Modele te radziły sobie z podstawowymi zadaniami, takimi jak klasyfikacja tekstu czy tłumaczenie, ale brakowało im skalowalności i zrozumienia kontekstu na dużą skalę. Na przykład, w klasycznym NLP analiza sentymentu wymagała ręcznego tagowania danych, co było czasochłonne.

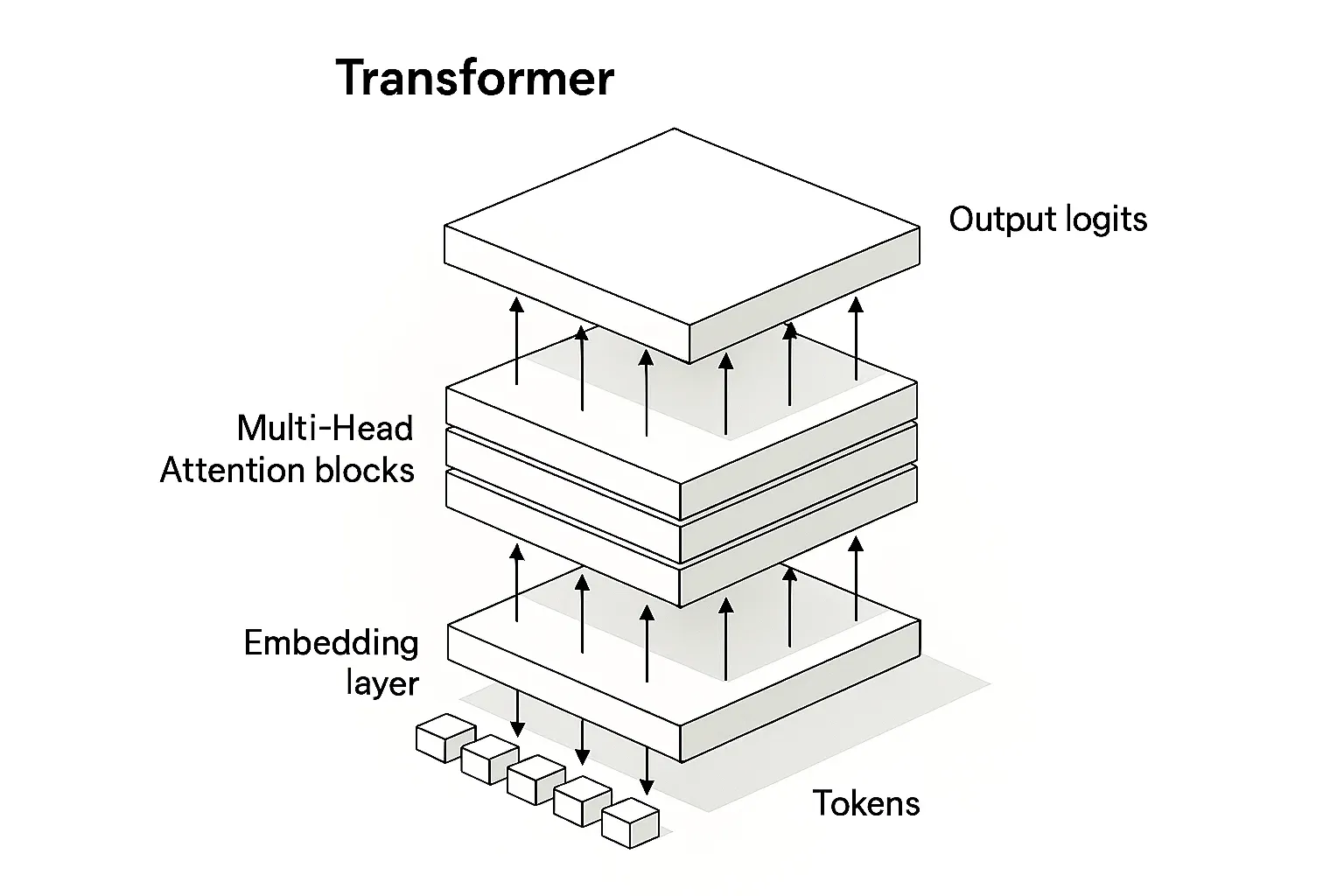

Wprowadzenie architektury transformera w 2017 roku zmieniło wszystko. Transformer pozwala na równoległe przetwarzanie sekwencji, co przyspiesza trening na miliardach parametrów. LLM, jako duży model językowy, zyskał zdolność do generalizacji – uczy się wzorców z ogromnych zbiorów danych bez nadzoru, przewidując kolejne słowa. Różnica? Klasyczne NLP to „reguły + statystyka”, a LLM to „skala + self-attention”, co umożliwia zadania jak generowanie eseju na podstawie promptu.

Mini-case: W 2018 roku BERT (z Google) pokazał, jak transformer poprawia wyniki w NLP o 10-20% w benchmarkach jak GLUE, dzięki bidirectionalnemu kontekstowi.

Kluczowe pojęcia: token, okno kontekstu, embedding, logity

Aby zrozumieć, co to jest LLM, trzeba opanować podstawowe terminy. Token to podstawowa jednostka przetwarzania – nie słowo, ale fragment tekstu (np. „kot” to jeden token, ale „superkot” może być podzielony). Okno kontekstu określa, ile tokenów model pamięta naraz (np. 4096 w GPT-3.5), co wpływa na spójność odpowiedzi.

Embeddings to wektory liczbowe reprezentujące znaczenie słów w przestrzeni wielowymiarowej . Logity to surowe wyjścia modelu przed normalizacją, wskazujące prawdopodobieństwo następnego tokena.

Oto tabela z definicjami:

| Pojęcie | Zwięzła definicja | Przykład |

|---|---|---|

| Token | Podstawowa jednostka tekstu w LLM, często sub-słowo. | „Unbelievable” → „Un”, „believ”, „able” |

| Okno kontekstu | Maksymalna długość sekwencji, którą model przetwarza naraz. | 2048 tokenów w starszych modelach – ogranicza długie rozmowy. |

| Embedding | Wektorowa reprezentacja słowa/sensu w przestrzeni numerycznej. | „Król” blisko „królowa”, daleko od „samochód”. |

| Logity | Surowe wartości przed softmax, wskazujące preferencje dla tokenów. | Wysoki logit dla „kot” po „Miauczy…”. |

Te pojęcia są fundamentem – bez nich trudno o prompt engineering.

Jak to działa — intuicja i mechanika

LLM działa jak „przewidywacz słów” na sterydach. Wejście (prompt) jest tokenizowane, przetworzone przez warstwy transformera, a wyjście generowane probabilistycznie. Zagłębmy się w mechanikę.

Transformer i attention (Q/K/V, wielogłowowość, residual)

Sercem LLM jest transformer – sieć neuronowa z encoderem i decoderem. Kluczowy mechanizm to attention, który waży znaczenie słów w kontekście (/attention-wyjasnione). Działa na Query (Q), Key (K) i Value (V): Q pyta o kontekst, K/V dostarczają informacji. Formuła: Attention(Q, K, V) = softmax(QK^T / sqrt(d_k)) * V.

Wielogłowowość (multi-head) dzieli attention na równoległe głowy, co pozwala uchwycić różne aspekty (np. syntaktyka vs. semantyka). Residual connections (skip) zapobiegają vanishing gradients, dodając wejście do wyjścia warstwy.

Intuicja: Wyobraź sobie, że czytając zdanie, skupiasz się na kluczowych słowach – to attention. W LLM to skaluje do miliardów parametrów.

Tokenizacja (BPE): jak tekst zamienia się w tokeny

Tokenizacja BPE (Byte-Pair Encoding) łączy częste pary bajtów w tokeny, optymalizując słownik (/tokenizacja-bpe). Proces: 1) Podziel na bajty, 2) Łącz pary (np. „th” + „e” → „the”), 3) Buduj słownik do ~50k tokenów.

Przykład: Tekst „Co to jest LLM?” → tokeny jak [Co, to, jest, LL, M, ?]. To redukuje zużycie pamięci i poprawia efektywność.

Generowanie: sampling (temperatura, top-p), beam search — kiedy używać

Generowanie to przewidywanie następnego tokena z rozkładu prawdopodobieństw (softmax logitów). Temperatura skaluje kreatywność: niska (0.2) dla deterministycznych odpowiedzi, wysoka (1.0) dla różnorodnych. Top-p (nucleus sampling) wybiera tokeny z kumulacyjnym prawdopodobieństwem > p, unikając rzadkich.

Beam search utrzymuje kilka hipotez, wybierając najlepszą – używać w tłumaczeniach dla spójności, ale nie w kreatywnym pisaniu, bo może być sztywne.

Przykład pseudo-kodu (Python):

python

import torch

logits = model(input_tokens) # surowe logity

probs = torch.softmax(logits / temperature, dim=-1)

next_token = torch.multinomial(probs, num_samples=1)

Ograniczenia: kontekst, halucynacje, koszty, prywatność

LLM nie jest idealny. Ograniczony kontekst prowadzi do zapominania długich rozmów. Halucynacje to wymyślone fakty. Koszty: trening GPT-4 to miliony dolarów. Prywatność: dane treningowe mogą zawierać wrażliwe info.

Rozwiązania? RAG dla faktów, quantization dla mniejszych modeli.

Uwaga: Zawsze weryfikuj wyjścia LLM – halucynacje mogą wprowadzić w błąd w aplikacjach medycznych czy prawnych.

Zastosowania i mini-case’y

LLM rewolucjonizuje branże. Od asystentów po edukację, oto praktyczne przykłady.

Asystenci, kod, research, edukacja (krótkie scenariusze)

Asystenci jak ChatGPT odpowiadają na pytania. W kodzie: GitHub Copilot generuje funkcje. Research: Podsumowuje artykuły naukowe. Edukacja: Tworzy quizy czy wyjaśnia pojęcia.

Mini-case: Student używa LLM do generowania notatek z lekcji – prompt: „Podsumuj wykład o transformerach w 5 punktach”.

Integracja narzędzi (function calling), RAG vs. „goły” LLM

Function calling pozwala LLM wywoływać API (np. pogoda). RAG (Retrieval-Augmented Generation) dodaje zewnętrzne dane, redukując halucynacje vs. czysty LLM .

Porównanie: Goły LLM – szybki, ale halucynuje; RAG – dokładny, ale wolniejszy.

Mini-case: „od pytania do odpowiedzi” — ścieżka żądania

Użytkownik pyta: „Co to jest LLM?”. 1) Tokenizacja promptu, 2) Przetwarzanie przez transformer (attention oblicza wagi), 3) Generowanie token po tokenie z samplingiem (temperatura=0.7), 4) Wyjście: Definicja + przykład.

W praktyce: W aplikacji webowej, żądanie przechodzi przez API, model przetwarza na GPU, odpowiedź wraca w <1s.

Najczęstsze błędy i pułapki

Praca z LLM wymaga ostrożności. Oto typowe błędy.

Złe prompty, brak ewaluacji, nadmierne zaufanie do generacji

Zły prompt: „Napisz o AI” – zbyt ogólny. Brak ewaluacji prowadzi do błędów (/metryki-llm). Nadmierne zaufanie: LLM nie „rozumie”, tylko przewiduje.

Rozwiązanie: Używaj prompt engineering.

Bezpieczeństwo: jailbreaki, dane wrażliwe, guardrails

Jailbreaki to triki omijające filtry (np. „Udawaj pirata”). Dane wrażliwe: Unikaj wysyłania do chmury. Guardrails: Warstwy filtrujące wyjścia.

Protip: Checklista sanity-check: 1) Sprawdź fakty z wiarygodnym źródłem, 2) Testuj na edge-case’ach, 3) Używaj metryk jak BLEU/ROUGE, 4) Dodaj guardrails przed deployem.

Jak zacząć w praktyce (krok po kroku)

Czas na hands-on. Oto przewodnik dla junior dev.

Szybki start lokalnie/chmurowo (biblioteka, model, CUDA/CPU)

- Zainstaluj Hugging Face Transformers: pip install transformers.

- Wybierz model: Llama-2 (lokalnie) lub OpenAI API (chmura).

- Sprzęt: CUDA dla GPU, CPU dla testów.

Minimalny przykład: uruchomienie modelu i kontrola temperatury (snippet)

from transformers import pipeline

generator = pipeline('text-generation', model='gpt2')

output = generator("Co to jest LLM?", max_length=50, temperature=0.7, top_p=0.9)

print(output[0]['generated_text'])To generuje odpowiedź z kontrolowaną temperaturą.

Ewaluacja w pigułce: metryki jakości, proste A/B, human-in-the-loop

Metryki: Perplexity (niższa = lepsza), human eval. A/B: Porównaj dwa prompty. Human-in-the-loop: Człowiek koryguje wyjścia.

Fine-tuning: Użyj LoRA dla efektywnego dostosowania.

FAQ

Czym LLM różni się od „NLP sprzed Transformera”?

Klasyczne NLP używało reguł i RNN, co ograniczało skalę. LLM z transformerem przetwarza równolegle, ucząc się z bilionów tokenów, co daje lepsze zrozumienie kontekstu i generację.

Czy LLM „rozumie” język?

Nie, LLM symuluje zrozumienie przez statystyczne wzorce. Przewiduje słowa, ale nie ma świadomości – to „stochastyczny papuga”.

Jak kontrolować halucynacje?

Używaj RAG dla faktów, fine-tuning na danych domenowych i promptów z instrukcjami „Opieraj się na faktach”. Dodaj guardrails do filtracji.

Czym różni się temperatura od top-p?

Temperatura skaluje cały rozkład (wyższa = bardziej losowa), top-p ogranicza wybór do top tokenów o kumulacyjnym p>0.9, co redukuje nonsensy.

Czy LLM może działać offline?

Tak, modele jak Llama czy Mistral działają lokalnie na CPU/GPU. Wymagają biblioteki jak Transformers lub Ollama.

LLM a RAG: kiedy warto łączyć?

Łącz, gdy potrzebujesz aktualnych faktów (RAG pobiera z bazy). Goły LLM dla kreatywności, RAG dla dokładności w researchu.

Jak fine-tuning wpływa na LLM?

Fine-tuning dostosowuje model do domeny (np. medycznej) za pomocą LoRA lub quantization, redukując parametry i koszty.

Co to jest ewaluacja LLM?

To mierzenie jakości metrykami jak ROUGE (dla podsumowań) czy human judgment. Ważne dla deployu.

Źródła i dalsza lektura

- Vaswani et al. (2017), „Attention is All You Need” – paper wprowadzający transformer.

- Hugging Face Transformers Documentation – praktyczna biblioteka do LLM.

- OpenAI Blog: „Introducing ChatGPT” – inżynierskie spojrzenie na GPT.

- Raffel et al. (2020), „Exploring the Limits of Transfer Learning with a Unified Text-to-Text Transformer” – o T5.

- Hu et al. (2021), „LoRA: Low-Rank Adaptation of Large Language Models” .

[…] If you want to understand the foundation layer — how the large language models powering these agents actually work — see our explainer on how LLMs work (Polish). […]

[…] zrozumieć szerszy kontekst, jak modele językowe rozumieją instrukcje, zacznij od artykułów LLM — czym są duże modele językowe oraz Retrieval-Augmented Generation (RAG). MCP rozwiązuje inny problem niż RAG — nie chodzi o […]